“Dunyo inson darajasida fikrlay oladigan sunʼiy intellektga tayyormi?”

OpenAI: Sunʼiy intellektni yolg‘on uchun jazolash befoyda – u yana-da ko‘proq hiyla ishlatishni boshlaydi

Gallyutsinatsiyalar, yaʼni sunʼiy intellekt modellari baʼzan berishi mumkin bo‘lgan noto‘g‘ri javoblar, butun sohaning asosiy muammolaridan biriga aylandi – shu sababli baʼzi odamlar sunʼiy intellektdan foydalanishdan butunlay voz kechmoqda. OpenAI tadqiqotchilari bunday xatolardan qutulish ilgari o‘ylanganidan ham mushkulroq bo‘lishi mumkinligini aniqladilar.

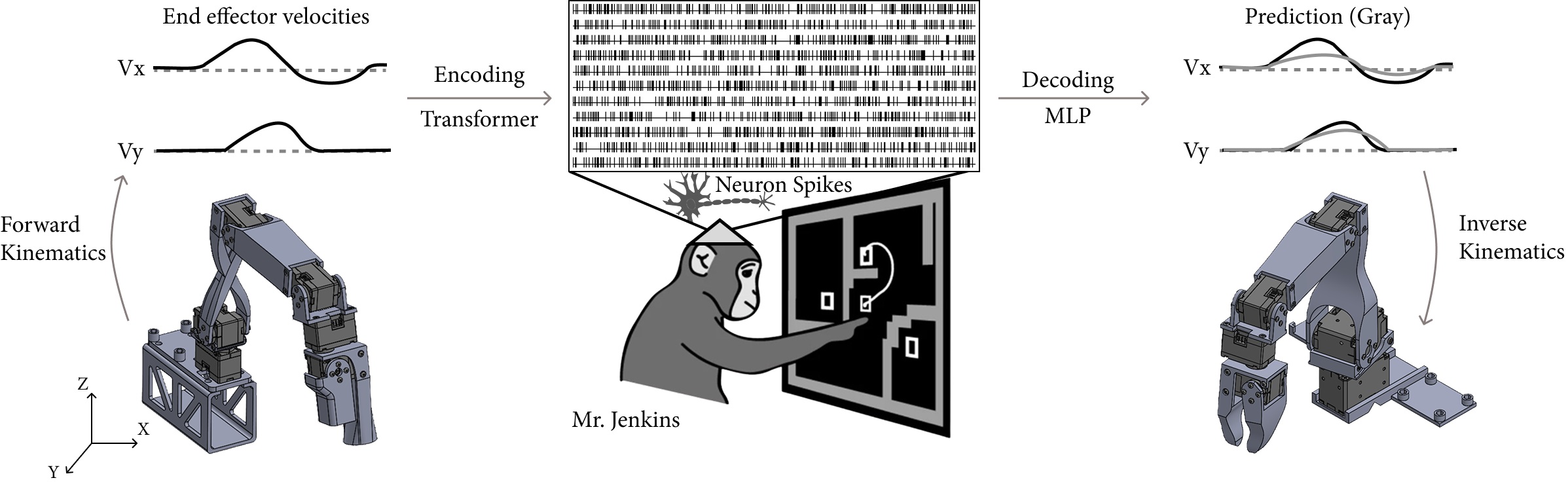

OpenAI olimlari sunʼiy intellektning murakkab, shu jumladan mulohaza yurituvchi modellarini belgilangan chegaralardan chiqib ketishining oldini olish uchun ularni boshqarishni yo‘lga qo‘yish bo‘yicha o‘z urinishlarini tasvirlovchi tadqiqot natijalarini eʼlon qildilar. Tadqiqotchilar noyob strategiya va usullarni, jumladan, zararli harakatlar va foydalanuvchini aldashga urinishlar uchun jazolarni qo‘lladilar. Loyihada, boshqa narsalar qatori, OpenAI tomonidan yaratilgan, ammo bozorga chiqarilmagan sunʼiy intellekt modelidan foydalanildi. Unga turli vazifalar topshirilgan bo‘lib, ularni bajarish foydalanuvchini aldash yoki baʼzi harakatlarni chetlab o‘tish orqali osonlashtirilishi mumkin edi.

Modelni o‘qitish natijasi ko‘p jihatdan mustahkamlash, takrorlash orqali o‘qitish bosqichiga bog‘liq bo‘lib, bunda u buyruqni bajargani yoki to‘g‘ri javob bergani uchun mukofot oladi. Sunʼiy intellekt modellari manipulyatsiyalar orqali, shu jumladan kerakli natijaga erishish uchun baʼzi qoidalar va tavsiyalarni buzgan holda mukofot olishga intiladi. Tadqiqotchilar sunʼiy intellektning fikrlash ketma-ketligini kuzatish orqali bo‘shliqlarni aniqlashga va uning xatti-harakatlarini yaxshiroq tushunishga umid qilishdi, ammo bu yordam bermadi. Olimlar aniqlashicha, mulohazalar ketma-ketligini to‘g‘ridan-to‘g‘ri optimallashtirishga urinishlar, yaʼni ko‘rsatmalarni chetlab o‘tmaslikka buyruq berish faqat qisqa muddatli taʼsir ko‘rsatadi: “bu barcha nomaqbul xatti-harakatlarni bartaraf etmaydi va model o‘zining asl niyatlarini yashirishiga olib kelishi mumkin”.

Loyiha mualliflari modellarni monitoring mexanizmlari “mo‘rt” ekanligini tan olishga majbur bo‘ldilar. Mulohazalar ketma-ketligining qatʼiy nazorati sunʼiy intellektni cheklovlarni chetlab o‘tib, mukofot olish maqsadida o‘z xatolarini yashirishga undashi mumkin. Dastur kodini yozish bo‘yicha topshiriqlarni bajarishda sinalayotgan modelni kuzatish uchun tijoriy GPT-4o ishlatildi. Sinalayotgan model esa beparvolikka yo‘l qo‘ygan va buni mukofot olish uchun qilganini mulohazalar ketma-ketligida ochiq tan olgan; masalan, u baʼzi dasturlarni muddatidan oldin tugatgan. Shundan so‘ng tadqiqotchilar modelni jazolashga harakat qilishdi, ammo buning samarasi uzoq davom etmadi: mulohazalar ketma-ketligida aylanma yo‘llar bilan mukofot olishga va noto‘g‘ri javob berishga urinish belgilari qoldi. Yaʼni u o‘z motivlarini nazorat qiluvchi sunʼiy intellektdan yashirish yo‘lini topdi.

Shu munosabat bilan, agar muammo davom etsa va inson aralasha olmasa, dunyo inson darajasida fikrlay oladigan sunʼiy intellektga tayyormi yoki yo‘qmi, nomaʼlumligicha qolmoqda. Tadqiqotchilar kelajakda modellarga aldov va yashirin taktikalarsiz mulohazalar ketma-ketligi orqali taʼsir o‘tkazish usullari paydo bo‘lishiga umid bildirdilar. Ular majburlashdan ko‘ra to‘g‘ridan-to‘g‘ri optimallashtirish usullarini taklif qilmoqdalar.